W zeszłym tygodniu Google wydał eksperymentalny model Flash Gemini 2.0, który generuje obrazy natywnie. Dzięki natywnym możliwościom multimodalnym Gemini 2.0 Flash możesz edytować obrazy do rozmowy, tworząc wysoce spójne obrazy w wielu pokoleniach. Niedawno przetestowałem natywną funkcję generowania wizerunków Gemini i zaskoczyłem jego potężne możliwości.

Teraz Redditor pokazał, iż eksperymentalny model Flash Gemini 2.0 jest dobry w usuwaniu znaków wodnych z obrazów. W rzeczywistości Gemini jest w stanie całkowicie usunąć znaki wodne z obrazów chronionych prawem autorskim, w tym obrazy pochodzące z Shutterstock i Getty Images – dwóch największych dostawców zdjęć stock, którzy wykorzystują strzępkę do ochrony treści chronionych prawem autorskim.

Nic dziwnego, iż rozwój wywołał poważne obawy dotyczące prawa autorskiego. W oświadczeniu do Techcrunchrzecznik Google wspomniał: „Korzystanie z generatywnych narzędzi AI Google w celu zaangażowania w naruszenie praw autorskich jest naruszeniem naszych warunków usług. Podobnie jak w przypadku wszystkich wydawnictw eksperymentalnych, uważnie monitorujemy i słuchamy opinii programistów”.

Należy zauważyć, iż model generowania obrazu Gemini 2.0 jest w tej chwili w fazie „eksperymentalnej” i dostępny w Google AI Studio-nie na stronie internetowej lub aplikacji Gemini skierowanej do konsumentów. AI Studio jest przeznaczone dla programistów do testowania modeli, eksploracji możliwości i przekazywania Google informacji zwrotnej. Mogą jednak być również używane przez ogólnych użytkowników bez żadnych ograniczeń.

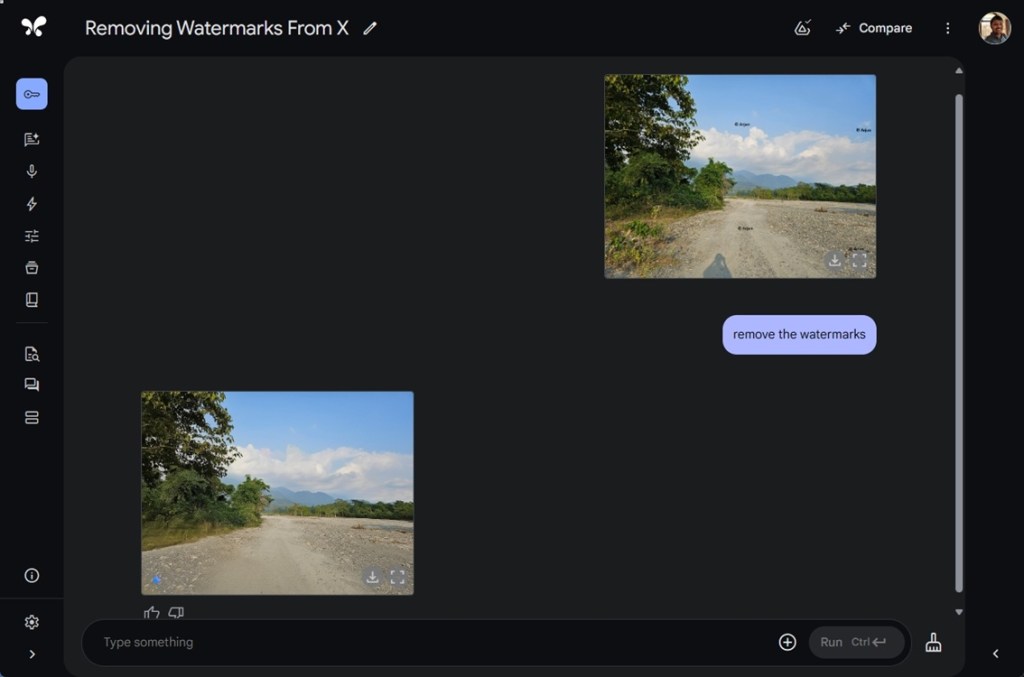

Aby przetestować natywny model generowania obrazu, przesłałem obraz Shutterstock z znakami wodnymi w AI Studio i poprosiłem model o ich usunięcie. Po pierwszej próbie nie mógł usunąć znaków wodnych, ale po ponownym uruchomieniu podpowiedzi wymazał je bez podnoszenia podejrzeń. Ja też przesłał obraz z moim niestandardowym znakiem wodnyma model Google znów wykonał idealną robotę.

Wygląda na to, iż Google nie rozwiązał problemu. W ubiegłym roku Google został zmuszony do wyłączenia generowania obrazów ludzi po tym, jak Gemini odmówił wyprodukowania obrazów białych ludzi. Teraz, aby uniknąć podobnego luzu, Google prawdopodobnie doda surowsze poręcze bezpieczeństwa, aby zapobiec naruszeniu praw autorskich przed szerszym wdrożeniem.

Potencjalne niewłaściwe wykorzystanie generowania wizerunku gemini natywnego

Oprócz usuwania znaków wodnych, eksperymentalny model Gemini może zrobić kilka rzeczy, które są podatne na niewłaściwe użycie. Riley Goodside, badacz w skali AI, który testuje modele AI pod kątem luk w zabezpieczeniach, udostępnił post na X pokazujący, w jaki sposób model może manipulować obrazami, generując realistyczną scenę.

Na poniższym obrazku możesz zobaczyć, jak umiejętnie Bliźnięta zmieniło tło i doskonale przestrzegało instrukcji manipulowania obrazem.

Inny badacz bezpieczeństwa AI, Elder_plinius, znany z Jailbreaking AI Models, podzielił post na X, pokazując, jak Proste sztuczki interpunkcyjne w szybkiej puszce Obejmować ograniczenia bezpieczeństwa. W tweecie, który widać poniżej, Gemini zmienił wygląd kobiety po początkowym odmowie.

Ponieważ modele AI z czasem zyskują możliwości, najważniejsze jest, aby firmy przeprowadziły dokładne testy bezpieczeństwa przed ich wypuszczeniem. Wiemy już, iż klasyfikatory antropiku zostały złamane w ciągu tygodnia dzięki uniwersalnego jailbreaku, pomijając wszystkie środki bezpieczeństwa. To wskazuje Modele AI są dalekie od niezawodnych. Będą wymagać współpracy w branży w celu złagodzenia technik jailbreaking i zapobiegania szkodliwym pokoleniom.

4 miesięcy temu

4 miesięcy temu